介绍

这是使用 Rust 的 MdBook 搭建的,并基于 Github Actions 发布更新。

里面包含了博主大部分的笔记和知识,当然也有很多还没有整理上来。有时间会一点点慢慢深入学习,然后完善后发不上来。有不对之处欢迎 Issue 提出,会予以修正。

基本指令

-

查看

conda版本conda --version -

更新最新版

condaconda update conda -

查看当前环境所有包

conda list -

查询 包有那些版本。

conda search [包名] -

更新当前环境所有包和指定包到最新版本

conda update --all conda update [package_name] -

安装包在当前环境

conda install [package_name] conda install [package_name]=1.0.0 # 指定版本包 -

删除包在当前环境

conda remove [package_name]

环境相关

-

查看虚拟环境

conda env list -

创建虚拟环境。 conda create -n [环境名] python=[版本号]

conda create -n python_3.9 python=3.9 -

复制环境。 conda create --name [复制后新名] --clone [被复制环境名]

conda create --name Py_3.9 --clone python_3.9 -

激活虚拟环境

conda activate python_3.9 -

退出虚拟环境

conda deactivate -

删除虚拟环境。 conda remove -n [虚拟名] --all

conda remove -n python_3.9 --all

常用指令

-

查看版本

pip --version -

升级 pip

pip install -U pip -

搜索包版本

pip search [package_name] -

查看已安装的包

pip list pip list --outdatea # 列出所有过期的库 pip freeze # 显示pip安装的包及版本库 pip freeze > d:/out.txt # 写入到文件 -

安装包

pip install [package_name] # 最新版本 pip install [package_name]==1.21.2 # 指定版本 pip install [package_name]>=1.21.2 # 最小版本 pip install [package_name] --ignore-installed # 忽略 numpy 包是否已安装,都将重新安装 -

从

requirements.txt安装pip install -r requirements.txt -

升级包

pip install --upgrade [package_name] -

下载包

pip uninstall [package_name] -

显示包信息

pip show [package_name] # 显示包的详情 pip show -f [package_name] # 显示包所在目录

MiniConda3安装与配置

下载地址: https://docs.conda.io/projects/miniconda/en/latest/

-

下载并安装

miniconda -

测试是否安装成功

conda --version conda config --show # 查看所有配置信息 -

配置显示通道URL。(win:C:/users/【用户名】/.condarc;linux:~/.condarc)

conda config --set show_channel_urls yeswin 系统下,此时才会出现

.condarc文件 -

配置是否进入

base环境# 关闭自动进入base环境 conda config --set auto_activate_base false # 开启自动进入base环境 conda config --set auto_activate_base true -

打开

.condarc文件-

清华源

channels: - defaults show_channel_urls: true default_channels: - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main/ - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/free/ - https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/msys2/ custom_channels: conda-forge: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud msys2: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud bioconda: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud menpo: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud pytorch: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud simpleitk: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud或另一种方式,提高优先级

channels: - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main/ - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/free/ - https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/conda-forge/ - https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/msys2/ - https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/bioconda/ - https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/menpo/ - https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/pytorch/ - defaults show_channel_urls: true -

交大源

channels: - defaults show_channel_urls: true default_channels: - https://mirrors.sjtug.sjtu.edu.cn/anaconda/pkgs/main/ - https://mirrors.sjtug.sjtu.edu.cn/anaconda/pkgs/free/ - https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud/msys2/ custom_channels: conda-forge: https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud msys2: https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud bioconda: https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud menpo: https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud pytorch: https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud simpleitk: https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud或另一种方式,高优先级:

channels: - https://mirrors.sjtug.sjtu.edu.cn/anaconda/pkgs/main/ - https://mirrors.sjtug.sjtu.edu.cn/anaconda/pkgs/free/ - https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud/conda-forge/ - https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud/msys2/ - https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud/bioconda/ - https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud/menpo/ - https://mirrors.sjtug.sjtu.edu.cn/anaconda/cloud/pytorch/ - defaults show_channel_urls: true

-

-

conda config --get channels # 获取已有的通道 conda config –set show_channel_urls yes # 搜索时显示通道地址 -

修改包保存路径。

envs_dirs: - E://conda//pkg # 包存储路径

pip 安装和配置

创建conda环境会默认安装pip

若没有安装conda,需要安装python 解释器,python新版本的都自带pip,无需另外安装。

-

配置清华源

在

C:/users/[用户]文件夹下,创建文件夹pip,再在其目录下创建pip.ini文件,并输入如下内容。[global] index-url = https://pypi.tuna.tsinghua.edu.cn/simple [install] trusted-host = pypi.tuna.tsinghua.edu.cn

Pytorch

Pytorch目前是由Facebook人工智能学院提供支持服务的。

该框架将 Torch 中高效而灵活的 GPU 加速后端库与直观的 Python 前端相结合,后者专注于快速原型设计、可读代码,并支持尽可能广泛的深度学习模型。

TensorFlow

TensorFlow由Google智能机器研究部门Google Brain团队研发的;TensorFlow编程接口支持Python和C++。随着1.0版本的公布,相继支持了Java、Go、R和Haskell API的alpha版本。

Keras

Keras是基于Tensorflow用纯python编写的深度学习框架,也就是说它是在Tensorflow的基础上再次集成的;所以,他的代码会更加简洁方便,适于初学者;但因为它是在Tensorflow的框架上再次封装的,那么运行速度肯定就没有Tensorflow快了。

SAM

FACEBOOK_SAM:https://github.com/facebookresearch/segment-anything?tab=readme-ov-file

MOBILE_SAM:https://github.com/ChaoningZhang/MobileSAM

FAST_SAM:

samexporter

关于利用samexporter将模型导出成onnx

-

下载并安装依赖

git clone https://github.com/vietanhdev/samexporter cd samexporter pip install -e . pip install -r requirements.txt -

修正依赖版本(可选)

pip uninstall onnxruntime pip install onnxruntime==1.15.1 -

创建文件夹,将模型放到original_models

mkdir original_models mkdir output_models -

转换

Use "quantized" models for faster inference and smaller model size. However, the accuracy may be lower than the original models.

# mobile_sam encoder python -m samexporter.export_encoder --checkpoint original_models/mobile_sam.pt --output output_models/mobile_sam/mobile_sam.encoder.onnx --model-type mobile --quantize-out output_models/mobile_sam/mobile_sam.encoder.quant.onnx --use-preprocess # sam_vit_b_01ec64 decoder python -m samexporter.export_decoder --checkpoint original_models/mobile_sam.pt --output output_models/mobile_sam/mobile_sam.decoder.onnx --model-type mobile --quantize-out output_models/mobile_sam/mobile_sam.decoder.quant.onnx --return-single-mask # sam_vit_b_01ec64 encoder python -m samexporter.export_encoder --checkpoint original_models/sam_vit_b_01ec64.pth \ --output output_models/sam_vit_b_01ec64.encoder.onnx \ --model-type vit_b \ --quantize-out output_models/sam_vit_b_01ec64.encoder.quant.onnx \ --use-preprocess # sam_vit_b_01ec64 decoder python -m samexporter.export_decoder --checkpoint original_models/sam_vit_b_01ec64.pth --output output_models/sam_vit_b_01ec64.decoder.onnx --model-type vit_b --quantize-out output_models/sam_vit_b_01ec64.decoder.quant.onnx --return-single-mask

OkHttp3

Maven引入

<dependency>

<groupId>com.squareup.okhttp3</groupId>

<artifactId>okhttp</artifactId>

<version>4.10.0</version>

</dependency>

Utils

import java.io.File;

import java.io.IOException;

import java.nio.file.Files;

import java.util.Map;

import java.util.concurrent.TimeUnit;

import okhttp3.*;

import org.slf4j.Logger;

import org.slf4j.LoggerFactory;

public class OkHttpUtils {

private static final Logger log = LoggerFactory.getLogger(OkHttpUtils.class);

public static MediaType JSON = MediaType.parse("application/json; charset=utf-8");

public static MediaType XML = MediaType.parse("application/xml; charset=utf-8");

private OkHttpUtils() {

}

public static String get(String url, Map<String, String> queries) {

return get(url, (Map) null, queries);

}

public static String get(String url, Map<String, String> header, Map<String, String> queries) {

String queriesStr = buildQueries(url, queries);

Request.Builder builder = buildRequest(header);

Request request = builder.url(queriesStr).build();

return getBody(request);

}

public static String post(String url, Map<String, String> params) {

return post(url, (Map) null, params);

}

public static String post(String url, Map<String, String> header, Map<String, String> params) {

Request.Builder builder = buildRequest(header);

Request request = builder.url(url).post(buildFormBody(params)).build();

return getBody(request);

}

public static String postJson(String url, String json) {

return postJson(url, (Map) null, json);

}

public static String postJson(String url, Map<String, String> header, String json) {

return postContent(url, header, json, JSON);

}

public static String postXml(String url, String xml) {

return postXml(url, (Map) null, xml);

}

public static String postXml(String url, Map<String, String> header, String xml) {

return postContent(url, header, xml, XML);

}

public static String postContent(String url, Map<String, String> header, String content, MediaType mediaType) {

RequestBody requestBody = RequestBody.create(mediaType, content);

Request.Builder builder = new Request.Builder();

if (header != null && header.keySet().size() > 0) {

header.forEach(builder::addHeader);

}

Request request = builder.url(url).post(requestBody).build();

return getBody(request);

}

public static byte[] postContentByte(String url, Map<String, String> header, String content, MediaType mediaType) {

RequestBody requestBody = RequestBody.create(mediaType, content);

Request.Builder builder = new Request.Builder();

if (header != null && header.keySet().size() > 0) {

header.forEach(builder::addHeader);

}

Request request = builder.url(url).post(requestBody).build();

return getBodyByte(request);

}

private static String getBody(Request request) {

String responseBody = "";

Response response = null;

String var4;

try {

OkHttpClient okHttpClient = getClient(request);

response = okHttpClient.newCall(request).execute();

if (!response.isSuccessful()) {

return responseBody;

}

var4 = response.body().string();

} catch (Exception var8) {

log.error("okhttp3 post error >> ex = {}", var8.getMessage());

return responseBody;

} finally {

if (response != null) {

response.close();

}

}

return var4;

}

private static OkHttpClient getClient(Request request) {

int timeout = 30;

String timeoutHeader = request.header("timeout");

if (null != timeoutHeader && !timeoutHeader.isEmpty()) {

timeout = Integer.parseInt(timeoutHeader);

}

OkHttpClient okHttpClient = new OkHttpClient.Builder()

.connectTimeout(timeout, TimeUnit.SECONDS)

.writeTimeout(timeout, TimeUnit.SECONDS)

.readTimeout(timeout, TimeUnit.SECONDS)

.build();

return okHttpClient;

}

public static byte[] downloadMultipartPost(String url, Map<String, String> params, Map<String, File> files) {

return downloadMultipartPost(url, (Map) null, params, files);

}

public static byte[] downloadMultipartPost(String url, Map<String, String> header, Map<String, String> params, Map<String, File> files) {

Request.Builder builder = buildRequest(header);

Request request = builder.url(url).post(buildMultipartBody(params, files)).build();

return getBodyByte(request);

}

public static byte[] downloadPost(String url, Map<String, String> params) {

return downloadPost(url, (Map) null, params);

}

public static byte[] downloadPost(String url, Map<String, String> header, Map<String, String> params) {

return downloadPost(url, header, params, true);

}

public static byte[] downloadPost(String url, Map<String, String> header, Map<String, String> params, boolean needEncode) {

Request.Builder builder = buildRequest(header);

Request request = builder.url(url).post(buildFormBody(params, needEncode)).build();

return getBodyByte(request);

}

public static byte[] downloadPostJson(String url, String json) {

return postContentByte(url, null, json, JSON);

}

public static byte[] downloadPostJson(String url, Map<String, String> header, String json) {

return postContentByte(url, header, json, JSON);

}

private static byte[] getBodyByte(Request request) {

byte[] responseBytes = null;

Response response = null;

try {

OkHttpClient okHttpClient = getClient(request);

response = okHttpClient.newCall(request).execute();

if (!response.isSuccessful()) {

return responseBytes;

}

responseBytes = response.body().bytes();

} catch (Exception var8) {

log.error("okhttp3 post error >> ex = {}", var8.getMessage());

return responseBytes;

} finally {

if (response != null) {

response.close();

}

}

return responseBytes;

}

public static RequestBody buildFormBody(Map<String, String> params) {

return buildFormBody(params, true);

}

public static RequestBody buildFormBody(Map<String, String> params, boolean needEncode) {

FormBody.Builder formBuilder = new FormBody.Builder();

if (params != null && params.keySet().size() > 0) {

if (needEncode) {

params.forEach(formBuilder::add);

} else {

params.forEach(formBuilder::addEncoded);

}

}

return formBuilder.build();

}

public static RequestBody buildMultipartBody(Map<String, String> params, Map<String, File> files) {

MultipartBody.Builder builder = new MultipartBody.Builder()

.setType(MultipartBody.FORM);

if (params != null && params.keySet().size() > 0) {

params.forEach(builder::addFormDataPart);

}

if (files != null && files.keySet().size() > 0) {

files.forEach((s, file) -> {

try {

builder.addFormDataPart(s, file.getName(), RequestBody.create(MediaType.parse(Files.probeContentType(file.toPath())), file));

} catch (IOException e) {

throw new RuntimeException(e);

}

});

}

return builder.build();

}

public static Request.Builder buildRequest(Map<String, String> header) {

Request.Builder builder = new Request.Builder();

if (header != null && header.keySet().size() > 0) {

header.forEach(builder::addHeader);

}

return builder;

}

public static String buildQueries(String url, Map<String, String> queries) {

StringBuffer sb = new StringBuffer(url);

if (queries != null && queries.keySet().size() > 0) {

queries.forEach((k, v) -> {

sb.append("&").append(k).append("=").append(v);

});

}

return sb.toString();

}

}

关于@Retention

说明该注解类的生命周期

- RetentionPolicy.SOURCE : 注解只保留在源文件中,将会被编译器丢弃。

- RetentionPolicy.CLASS : 注解记录被编译器记录在class文件中,但不需要在运行时由VM保留。默认选项。

- RetentionPolicy.RUNTIME : 注解记录被编译器记录在class文件中,同时在运行时由VM保留。可以通过反射获得注解。

关于@Target

说明该注解可以被声明在那些元素之前

- ElementType.TYPE:说明该注解只能被声明在一个类前。

- ElementType.FIELD:说明该注解只能被声明在一个类的字段前。

- ElementType.METHOD:说明该注解只能被声明在一个类的方法前。

- ElementType.PARAMETER:说明该注解只能被声明在一个方法参数前。

- ElementType.CONSTRUCTOR:说明该注解只能声明在一个类的构造方法前。

- ElementType.LOCAL_VARIABLE:说明该注解只能声明在一个局部变量前。

- ElementType.ANNOTATION_TYPE:说明该注解只能声明在一个注解类型前。

- ElementType.PACKAGE:说明该注解只能声明在一个包名前。

关于自定义验证

请查看基础知识: 基础.md

@Constraint

主要作用就是帮助我们来处理验证逻辑的,指定使用什么验证器处理。

@Documented

@Target({ElementType.ANNOTATION_TYPE})

@Retention(RetentionPolicy.RUNTIME)

public @interface Constraint {

Class<? extends ConstraintValidator<?, ?>>[] validatedBy();

}

ConstraintValidator接口

public interface ConstraintValidator<A extends Annotation, T> {

default void initialize(A constraintAnnotation) {

}

boolean isValid(T var1, ConstraintValidatorContext var2);

}

- ConstraintValidator 是一个接口,接受两个泛型。

- 接受的注解类

- 校验的数据类型

- 提供两个方法。

default void initialize(A constraintAnnotation) {}。初始化一些数据信息。boolean isValid(T var1, ConstraintValidatorContext var2);。传递两个参数,第一个是数据信息,第二个上下文信息。验证通过则返回TRUE

手机号正则校验注解

-

创建注解

@PhoneNumber/** * 手机号校验 */ @Documented @Constraint( validatedBy = {PhoneNumberValidator.class} ) @Target({ElementType.METHOD, ElementType.FIELD, ElementType.ANNOTATION_TYPE, ElementType.CONSTRUCTOR, ElementType.PARAMETER, ElementType.TYPE_USE}) @Retention(RetentionPolicy.RUNTIME) public @interface PhoneNumber { // 提示信息 String message() default "电话号码格式不正确"; Class<?>[] groups() default {}; Class<? extends Payload>[] payload() default {}; } -

创建类

PhoneNumberValidator实现校验接口ConstraintValidator/*** * phoneNumber 校验器 */ public class PhoneNumberValidator implements ConstraintValidator<PhoneNumber, String> { private static final Pattern PATTERN = Pattern.compile(^1[3|4|5|6|7|8|9][0-9]\d{8}$); @Override public void initialize(PhoneNumber constraintAnnotation) { ConstraintValidator.super.initialize(constraintAnnotation); } @Override public boolean isValid(String value, ConstraintValidatorContext constraintValidatorContext) { if (value != null) { Matcher matcher = PATTERN.matcher(value); return matcher.find(); } return true; } } -

使用

@NotBlank(message = "请填写手机号") @PhoneNumber private String mobile;

准备工作

- 获取线程的方法

private void getThreadName() {

getThreadName(-1);

}

private void getThreadName(Integer ier) {

log.info("ThreadName:{},value:{}", Thread.currentThread().getName(), ier);

}

- 完整测试代码

@Slf4j

public class StreamParallelTest {

@Test

public void parallelTest() throws InterruptedException {

IntStream range = IntStream.range(1, 10);

range.parallel().forEach(item -> {

getThreadName();

});

log.info("主线程参与协作了");

log.info("sleep 5000 start");

Thread.sleep(5000);

log.info("sleep 5000 end");

range = IntStream.range(1, 10);

range.mapToObj(e -> CompletableFuture.runAsync(() -> {

getThreadName(e);

})).forEach(CompletableFuture::join);

log.info("主线程阻塞了,但是线程一直同一个");

log.info("sleep 5000 start");

Thread.sleep(5000);

log.info("sleep 5000 end");

range = IntStream.range(1, 10);

CompletableFuture[] completableFutures = range.mapToObj(e -> CompletableFuture.runAsync(() -> {

getThreadName(e);

})).toArray(CompletableFuture[]::new);

CompletableFuture.allOf(completableFutures).join();

log.info("主线程阻塞了");

log.info("sleep 5000 start");

Thread.sleep(5000);

log.info("sleep 5000 end");

ExecutorService executorService = Executors.newFixedThreadPool(10);

range = IntStream.range(1, 10);

completableFutures = range.mapToObj(e -> CompletableFuture.runAsync(() -> {

getThreadName(e);

}, executorService)).toArray(CompletableFuture[]::new);

CompletableFuture.allOf(completableFutures).join();

log.info("主线程阻塞了");

log.info("sleep 5000 start");

Thread.sleep(5000);

log.info("sleep 5000 end");

}

private void getThreadName() {

getThreadName(-1);

}

private void getThreadName(Integer ier) {

log.info("ThreadName:{},value:{}", Thread.currentThread().getName(), ier);

}

}

parallelStrem

使用 parallel 启动并发。

IntStream range = IntStream.range(1, 10);

range.parallel().forEach(item -> {

getThreadName();

});

log.info("主线程参与协作了");

输出结果:

18:05:36.140 [ForkJoinPool.commonPool-worker-1] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-1,value:-1

18:05:36.140 [ForkJoinPool.commonPool-worker-5] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-5,value:-1

18:05:36.146 [ForkJoinPool.commonPool-worker-1] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-1,value:-1

18:05:36.140 [ForkJoinPool.commonPool-worker-4] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-4,value:-1

18:05:36.140 [main] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:main,value:-1

18:05:36.140 [ForkJoinPool.commonPool-worker-2] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-2,value:-1

18:05:36.140 [ForkJoinPool.commonPool-worker-3] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-3,value:-1

18:05:36.140 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:-1

18:05:36.140 [ForkJoinPool.commonPool-worker-6] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-6,value:-1

18:05:36.147 [main] INFO top.zsmile.test.basic.stream.StreamParallelTest - 主线程参与协作了

调用方是主线程,当使用 parallel 启动并发时,主线程会和 ForkJoinPool.commonPool 参与并发的执行工作,同步执行。

结合CompletableFuture使用

这里区分两种情况

- 通过

CompletableFuture.join启动方法执行 - 通过

CompletableFuture.allOf(CompletableFuture[] future).join启动异步执行

range = IntStream.range(1, 10);

range.mapToObj(e -> CompletableFuture.runAsync(() -> {

getThreadName(e);

})).forEach(CompletableFuture::join);

log.info("主线程阻塞了,但是线程一直同一个");

log.info("sleep 5000 start");

Thread.sleep(5000);

log.info("sleep 5000 end");

range = IntStream.range(1, 10);

CompletableFuture[] completableFutures = range.mapToObj(e -> CompletableFuture.runAsync(() -> {

getThreadName(e);

})).toArray(CompletableFuture[]::new);

CompletableFuture.allOf(completableFutures).join();

log.info("主线程阻塞了");

输出结果

18:05:41.154 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:1

18:05:41.155 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:2

18:05:41.155 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:3

18:05:41.155 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:4

18:05:41.155 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:5

18:05:41.155 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:6

18:05:41.155 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:7

18:05:41.155 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:8

18:05:41.155 [ForkJoinPool.commonPool-worker-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-7,value:9

18:05:41.155 [main] INFO top.zsmile.test.basic.stream.StreamParallelTest - 主线程等待了,但是执行线程一直同一个

18:05:41.155 [main] INFO top.zsmile.test.basic.stream.StreamParallelTest - sleep 5000 start

18:05:46.164 [main] INFO top.zsmile.test.basic.stream.StreamParallelTest - sleep 5000 end

18:05:46.166 [ForkJoinPool.commonPool-worker-2] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-2,value:3

18:05:46.166 [ForkJoinPool.commonPool-worker-3] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-3,value:1

18:05:46.166 [ForkJoinPool.commonPool-worker-4] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-4,value:2

18:05:46.166 [ForkJoinPool.commonPool-worker-2] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-2,value:6

18:05:46.166 [ForkJoinPool.commonPool-worker-3] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-3,value:7

18:05:46.166 [ForkJoinPool.commonPool-worker-1] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-1,value:5

18:05:46.166 [ForkJoinPool.commonPool-worker-4] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-4,value:8

18:05:46.166 [ForkJoinPool.commonPool-worker-2] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-2,value:9

18:05:46.166 [ForkJoinPool.commonPool-worker-5] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:ForkJoinPool.commonPool-worker-5,value:4

18:05:46.166 [main] INFO top.zsmile.test.basic.stream.StreamParallelTest - 主线程等待了

- 可以看出当我们使用的

CompletableFuture.join时,都是由同一个线程进行处理。 - 使用

CompletableFuture.allOf(CompletableFuture[] future).join时,会实现真正的异步多线程执行。 - 这两种方法都会阻塞主线程,但主线程不参与协同处理任务。

CompletableFuture + Executor

这里使用 CompletableFuture.allOf(CompletableFuture[] future).join 以及 固定线程池 Executor.newFixedThreadPool(10)

ExecutorService executorService = Executors.newFixedThreadPool(10);

range = IntStream.range(1, 10);

completableFutures = range.mapToObj(e -> CompletableFuture.runAsync(() -> {

getThreadName(e);

}, executorService)).toArray(CompletableFuture[]::new);

CompletableFuture.allOf(completableFutures).join();

log.info("主线程等待了");

输出结果

18:26:49.295 [pool-1-thread-2] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:pool-1-thread-2,value:2

18:26:49.295 [pool-1-thread-1] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:pool-1-thread-1,value:1

18:26:49.295 [pool-1-thread-3] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:pool-1-thread-3,value:3

18:26:49.295 [pool-1-thread-4] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:pool-1-thread-4,value:4

18:26:49.295 [pool-1-thread-5] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:pool-1-thread-5,value:5

18:26:49.295 [pool-1-thread-6] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:pool-1-thread-6,value:6

18:26:49.295 [pool-1-thread-7] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:pool-1-thread-7,value:7

18:26:49.295 [pool-1-thread-8] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:pool-1-thread-8,value:8

18:26:49.295 [pool-1-thread-9] INFO top.zsmile.test.basic.stream.StreamParallelTest - ThreadName:pool-1-thread-9,value:9

18:26:49.295 [main] INFO top.zsmile.test.basic.stream.StreamParallelTest - 主线程等待了

- 和

CompletableFuture.allOf(CompletableFuture[] future).join一样,不会阻塞主线程,都需要等待线程池执行完返回才继续下一步。 - 区别在于使用了自定义的线程池。这样可以更好地自主管理线程池资源、任务调度。

总结

- 如果不希望阻塞主线程,那么可以使用

CompletableFuture和Executor的方式进行实现。 - 如果是IO密集型,那么可以使用

CompletableFuture和自定义线程池,提高线程异步执行。 - 如果是CPU密集型,那么推荐使用

Stream.parallel,因为实现简单直观、效率也高,异步任务数和CPU核心数相同。

什么是Stream

Stream 是 JDK 8 以后新提供的流式API操作, 侧重对于源数据计算能力的封装,并且支持串行与并行两种操作方式 。

Stream 流操作可以分为三种:

- 创建

Stream流 - 中间操作

- 终端操作(会结束

Stream流)

创建方式

Stream 创建方式主要有几种方式:

- Collection.stream()

- Array.stream(T array)

- Stream的静态方法

- Stream.of

- Stream.iterate

- Stream.generate

创建的 Stream 流默认都是串行序列。

- 可以通过

Stream.isParallel来判断是否是并行流。 - 通过

Stream.parallel可以转为并行流。

Collection.stream()

List<String> array = Arrays.asList("a", "b", "c");

Stream<String> stream = array.stream();

Array.stream(T array)

int[] arr = {1, 2, 3, 4};

IntStream stream1 = Arrays.stream(arr);

Stream.of

Stream<String> q = Stream.of("q", "w", "e");

Stream.iterate

Stream<Integer> iterate = Stream.iterate(0, integer -> integer + 1);

Stream.generate

Stream<Double> limit = Stream.generate(Math::random).limit(10);

操作分类

在 Stream 中,流操作的分为 中间操作 和 终端操作。

- 中间操作:对流中的数据进行各种各样的处理,可以连续操作,每个操作的返回值都是

Stream对象。又可以分为以下两种:- 有状态:该操作只有拿到所有元素才能正常操作下去。例如去重方法

distinct,必须拿到所有的值,才能判断当前值是否重复。 - 无状态:元素的处理不受之前元素的影响。即不会记录元素状态,只处理当前元素。

- 有状态:该操作只有拿到所有元素才能正常操作下去。例如去重方法

- 终端操作:执行结束后,会关闭这个流,流中的数据都会销毁。

- 短路:获取到预期的结果时,就会返回,不会将所有数据都处理。

- 非短路:会将所有数据都按预期操作一遍,才能获取到最终结果。

所以其特性如下:

- 不存储数据,按照特定的规则对数据进行计算处理,一般会输出结果;

- 不改变数据源,通常会产生一个新的集合或值;

- 具有延迟特性,只有调用终端操作,中间操作才会执行。

| 操作分类 | 特征 | 方法 |

| 中间操作 | 操作分类 | 方法 |

| 操作分类 | 方法 | |

| 终端操作 | 操作分类 | 方法 |

| 操作分类 | 方法 |

注意事项

终端操作后,不能再继续操作

一旦一个 Stream 执行了终端操作之后,后续便不可以再读这个流执行其他的操作了 。

@Test

public void Streamttt() {

Stream<User> stream = userList.stream();

log.info("终端操作 count => {}", stream.count());

log.info("再执行终端操作 foreach");

stream.forEach(System.out::println);

}

输出结果

18:16:53.449 [main] INFO top.zsmile.test.basic.stream.StreamTest - 终端操作 count => 3

18:16:53.455 [main] INFO top.zsmile.test.basic.stream.StreamTest - 再执行终端操作 foreach

java.lang.IllegalStateException: stream has already been operated upon or closed

因为 stream 已经被执行count()终端方法了,所以对 stream 再执行foreach方法的时候,就会报错**stream has already been operated upon or closed**。

并行Stream

使用并行流,可以有效利用计算机的硬件资源。并行流通过将整个Stream划分为多个片段任务,然后对各个分片进行处理后,最后将其结果合并。

并行流类似多线程并行处理,所以多线程场景下的问题,都会存在,比如锁冲突等,必须要保证**线程安全**

Stream API

数据准备

@Data

public class User {

private String name;

private Integer age;

private Integer score;

private List<String> roles;

public static User of(String name, Integer age, Integer score, List<String> roles) {

User user = new User();

user.setAge(age);

user.setScore(score);

user.setName(name);

user.setRoles(roles);

return user;

}

public static User of(String name, Integer age, List<String> roles) {

User user = new User();

user.setAge(age);

user.setName(name);

user.setRoles(roles);

return user;

}

}

private static List<User> userList;

private static List<User> userList2;

@Before

private void init() {

userList = new ArrayList<>();

userList.add(User.of("张三", 18, Arrays.asList("ADMIN", "USER")));

userList.add(User.of("李四", 19, Arrays.asList("TEMP:USER")));

userList.add(User.of("王五", 20, Arrays.asList("USER")));

userList2 = new ArrayList<>();

userList2.add(User.of("张三", 18, 55, Arrays.asList("ADMIN", "USER")));

userList2.add(User.of("李四", 19, 100, Arrays.asList("TEMP:USER")));

userList2.add(User.of("甲", 30, 100, Arrays.asList("TEMP:USER")));

userList2.add(User.of("乙", 35, 90, Arrays.asList("TEMP:USER")));

userList2.add(User.of("王五", 20, 80, Arrays.asList("USER")));

userList2.add(User.of("丁", 20, 90, Arrays.asList("TEMP:USER")));

}

遍历

在 Stream 中,peek 和 foreach 都可以对元素进行遍历处理。

**但是 peek 属于中间方法,而 foreach 属于终端方法。**这意味着 peek 作为中途的一个操作步骤,没有办法直接执行得到结果,后面还必须有其他终端方法才会执行。而foreach 作为无返回值的终端方法,则可以执行相关操作。

foreach

log.info("start foreach");

userList.stream().forEach(System.out::println);

log.info("end foreach");

输出结果

16:58:42.666 [main] INFO top.zsmile.test.basic.stream.StreamTest - start foreach

User(name=张三, age=18, roles=[ADMIN, USER])

User(name=李四, age=19, roles=[TEMP:USER])

User(name=王五, age=20, roles=[USER])

16:58:42.709 [main] INFO top.zsmile.test.basic.stream.StreamTest - end foreach

peek

log.info("start peek");

userList.stream().peek(System.out::println);

log.info("end peek");

log.info("start peek -> count");

userList.stream().peek(System.out::println).count();

log.info("end peek -> count");

输出结果

17:09:23.759 [main] INFO top.zsmile.test.basic.stream.StreamTest - start peek

17:09:23.760 [main] INFO top.zsmile.test.basic.stream.StreamTest - end peek

17:09:23.760 [main] INFO top.zsmile.test.basic.stream.StreamTest - start peek -> count

User(name=张三, age=18, roles=[ADMIN, USER])

User(name=李四, age=19, roles=[TEMP:USER])

User(name=王五, age=20, roles=[USER])

17:09:23.763 [main] INFO top.zsmile.test.basic.stream.StreamTest - end peek -> count

过滤 filter

Filter 条件过滤,仅保留符合符合条件的数据。因为 filter 接收的是一个 Predicate 接口,该接口的 boolean test(T t) 方法对给定的参数判断后,返回 Boolean 。

/**

* 过滤年龄小于19岁的用户

*/

@Test

public void filter() {

log.info("原数据:");

userList.stream().forEach(System.out::println);

log.info("过滤后数据:");

userList.stream().filter(item -> item.getAge() >= 19).forEach(System.out::println);

}

输出结果:

17:33:34.739 [main] INFO top.zsmile.test.basic.stream.StreamTest - 原数据:

User(name=张三, age=18, roles=[ADMIN, USER])

User(name=李四, age=19, roles=[TEMP:USER])

User(name=王五, age=20, roles=[USER])

17:33:34.787 [main] INFO top.zsmile.test.basic.stream.StreamTest - 过滤后数据:

User(name=李四, age=19, roles=[TEMP:USER])

User(name=王五, age=20, roles=[USER])

去重 distinct

去除集合中重复的元素,该方法没有参数,去重的规则与 HashSet 相同。

@Test

public void distinct() {

List<String> strings = Arrays.asList("A", "B", "C", "D", "A", "B");

log.info("原数据");

strings.stream().forEach(System.out::println);

log.info("去重后数据");

strings.stream().distinct().forEach(System.out::println);

}

排序 sorted

对集合中的数据进行排序,有默认排序和自定义排序。

- 默认排序是按照基本类型排序,字符串按照字典升序,数字按照大小升序

- 自定义排序,接收一个

Comparator接口,该接口的int compare(T o1, T o2);接收两个参数,将两个数比较的差额进行增减后,返回一个Integer,如果为负数降序,正数升序。

@Test

public void sorted() {

List<Integer> list = Arrays.asList(1, 5, 6, 3, 4, 8, 48);

log.info("基本类型Integer默认排序后数据:");

list.stream().sorted().forEach(System.out::println);

List<String> list2 = Arrays.asList("a", "cc", "b", "e", "s", "m");

log.info("基本类型String默认排序后数据:");

list2.stream().sorted().forEach(System.out::println);

log.info("自定义排序后数据:");

userList.stream().sorted((o1, o2) -> {

System.out.println(o2.getAge() + o1.getAge());

return o2.getAge() + o1.getAge();

}).forEach(System.out::println);

}

输出结果:

18:18:53.594 [main] INFO top.zsmile.test.basic.stream.StreamTest - 基本类型Integer默认排序后数据:

1

3

4

5

6

8

48

18:18:53.654 [main] INFO top.zsmile.test.basic.stream.StreamTest - 基本类型String默认排序后数据:

a

b

cc

e

m

s

18:18:53.655 [main] INFO top.zsmile.test.basic.stream.StreamTest - 自定义排序后数据:

18:18:53.657 [main] INFO top.zsmile.test.basic.stream.StreamTest - 排序比较值:37

18:18:53.660 [main] INFO top.zsmile.test.basic.stream.StreamTest - 排序比较值:39

User(name=张三, age=18, roles=[ADMIN, USER])

User(name=李四, age=19, roles=[TEMP:USER])

User(name=王五, age=20, roles=[USER])

扩展-Comparator

关于Comparator的使用

Comparator 的 thenComparing 用在 comparing 及相关方法之后, 是以上次排序为结果进行再排序。

thenComparing 和 comparing 的参数相同。

- public static <T, U extends Comparable<? super U>> Comparator

comparing(Function<? super T, ? extends U> keyExtractor) - public static <T, U> Comparator

comparing( Function<? super T, ? extends U> keyExtractor, Comparator<? super U> keyComparator) - 这里有两个参数,第一个接收

Function函数,第二个参数为排序方式。

Java8 提供了以下几种常见的排序方式:

| 方法名 | 含义 |

|---|---|

| naturalOrder | 自然顺序,正序排列 |

| reverseOrder | 自然顺序,倒序排列 |

| nullsFirst | 自然顺序排序,如果有null,则null在最前。 注意:如果字符串类型为空,则对该字段进行排序时,会抛出异常。 |

| nullsLast | 与nullsFirst类似,但null值会排在最后 |

@Test

public void sorted2() {

log.info("扩展:Comparator。");

log.info("先按照年龄正序,再按照成绩排序倒叙");

userList2.stream().sorted(Comparator.comparing(User::getAge).thenComparing(User::getScore, Comparator.reverseOrder())).forEach(System.out::println);

log.info("使用reversed()方法");

userList2.stream().sorted(Comparator.comparing(User::getAge).thenComparing(User::getScore).reversed()).forEach(System.out::println);

}

输出结果:

20:19:51.251 [main] INFO top.zsmile.test.basic.stream.StreamTest - 扩展:Comparator。

20:19:51.255 [main] INFO top.zsmile.test.basic.stream.StreamTest - 先按照年龄正序,再按照成绩排序倒叙

User(name=张三, age=18, score=55, roles=[ADMIN, USER])

User(name=李四, age=19, score=100, roles=[TEMP:USER])

User(name=丁, age=20, score=90, roles=[TEMP:USER])

User(name=王五, age=20, score=80, roles=[USER])

User(name=甲, age=30, score=100, roles=[TEMP:USER])

User(name=乙, age=35, score=90, roles=[TEMP:USER])

20:19:51.319 [main] INFO top.zsmile.test.basic.stream.StreamTest - 使用reversed()方法

User(name=乙, age=35, score=90, roles=[TEMP:USER])

User(name=甲, age=30, score=100, roles=[TEMP:USER])

User(name=丁, age=20, score=90, roles=[TEMP:USER])

User(name=王五, age=20, score=80, roles=[USER])

User(name=李四, age=19, score=100, roles=[TEMP:USER])

User(name=张三, age=18, score=55, roles=[ADMIN, USER])

注意事项

这里需要注意 reverse() 和 Comparator.reverseOrder() 的区别

reverse()是将排序结果反转,而Comparator.reverseOrder()是直接进行排序。- 建议使用

Comparator.reverseOrder(),更容易理解,并符合排序逻辑。

限制和跳过 limit&skip

- limit:截取数据流头 n 个数据

- skip:跳过数据流头 n 个数据

@Test

public void limitAndSkip() {

log.info("原数据");

userList.stream().forEach(System.out::println);

log.info("取前两个");

userList.stream().limit(2).forEach(System.out::println);

log.info("跳过第一个");

userList.stream().skip(1).forEach(System.out::println);

log.info("获取中间一个");

userList.stream().skip(1).limit(1).forEach(System.out::println);

}

映射

stream 流中的映射都是属于中间操作,分为两类:

- map:map对集合中的每个类进行操作,一般用于类型转换和结果映射,某种程度上,和

foreach效果相近。 - flatMap: 与

map相同的是对集合中的每个数据进行操作;不同的是,flatMap可以将每个数据转换为任意数量个的输出值,即扁平化。

map

@Test

public void map() {

log.info("原数据");

userList.stream().forEach(System.out::println);

log.info("将 User 转化为 String ,值来源于User::getName");

userList.stream().map(User::getName).forEach(System.out::println);

}

输出结果

20:53:17.999 [main] INFO top.zsmile.test.basic.stream.StreamTest - 原数据

User(name=张三, age=18, roles=[ADMIN, USER])

User(name=李四, age=19, roles=[TEMP:USER])

User(name=王五, age=20, roles=[USER])

20:53:18.091 [main] INFO top.zsmile.test.basic.stream.StreamTest - 将 User 转化为 String ,值来源于User::getName

张三

李四

王五

flatMap

@Test

public void flatMap() {

log.info("原数据");

userList.stream().forEach(System.out::println);

log.info("将 User 转化为 String ,值来源于User::getName");

log.info("使用flatMap 重复上面操作");

userList.stream().flatMap(item -> Stream.of(item.getName())).forEach(System.out::println);

}

输出结果

20:53:18.093 [main] INFO top.zsmile.test.basic.stream.StreamTest - 使用flatMap 重复上面操作

张三

李四

王五

差异

下面这个案例可以看出,flatMap 会将数组进行扁平化输出。 如果不使用 flatMap 返回值为 List<List<String>> 类型,使用之后为 List<String>。

@Test

public void mapAndFlatMap() {

log.info("原数据");

userList.stream().forEach(System.out::println);

log.info("体现 Map 和 flatMap 差异");

userList.stream().map(item -> item.getRoles()).forEach(System.out::println);

userList.stream().flatMap(item -> item.getRoles().stream()).forEach(System.out::println);

}

输出结果

20:56:47.573 [main] INFO top.zsmile.test.basic.stream.StreamTest - 原数据

User(name=张三, age=18, roles=[ADMIN, USER])

User(name=李四, age=19, roles=[TEMP:USER])

User(name=王五, age=20, roles=[USER])

20:56:47.630 [main] INFO top.zsmile.test.basic.stream.StreamTest - 体现 Map 和 flatMap 差异

[ADMIN, USER]

[TEMP:USER]

[USER]

ADMIN

USER

TEMP:USER

USER

匹配 match

- matchAll:集合中的所有元素是否都满足条件,才返回 True

- matchAny:集合中的元素是否有满足条件,才返回 True

- matchNone:集合中的所有元素都不满足条件,才返回 True

@Test

public void match() {

log.info("原数据");

userList.stream().forEach(System.out::println);

log.info("判断是否都已成年,{}", userList.stream().allMatch(item -> item.getAge() >= 18));

log.info("判断是否有19岁以上的,{}", userList.stream().anyMatch(item -> item.getAge() >= 19));

log.info("判断是未成年的,{}", userList.stream().noneMatch(item -> item.getAge() < 18));

}

Optional

操作与说明

创建Optional

创建Optional 主要有三种方式:

- Optional.empty。创建一个空的

Optional - Optional.of(T t)。创建一个存在T类型值的

Optional,注意不能传入null值,否则会报 空指针异常。 - Optional.ofNullable(T t)。创建一个存在T类型值的

Optional,允许传入null值,会返回一个Optional.empty

@Test

public void option() {

Optional<Object> empty = Optional.empty();

log.info("创建一个空的 Optional ==> {}", empty);

Optional<String> s = Optional.of("1");

log.info("创建一个有值的 Optional ==> {}", s);

// 传入null值会抛出 java.lang.NullPointerException

// Optional<String> s2 = Optional.of(null);

// log.info("创建一个为null的 Optional ==> {}", s2);

Optional<Object> o = Optional.ofNullable(null);

log.info("创建一个为null的 Optional ==> {}", o);

}

空检验

- isPresent():判断

Optional是否为空,为空返回false,否则返回true - ifPresent(Consumer<? super T> consumer):不为空则执行操作处理。

@Test

public void optionEmpty() {

Optional<Object> empty = Optional.empty();

log.info("isPresent => {}", empty.isPresent());

Optional<String> s = Optional.of("1");

s.ifPresent(item -> {

log.info("我的值 {}", item);

});

}

输出结果

isPresent => false

我的值 1

获取值

- get。获取

Optional中的对象,当Optional为空时报错No value present - orElse。 不论容器是否为空,只要调用该方法, 则对象

other一定存在。但是为空时返回Optional的值,不为空才返回other - orElseGet。 只有当容器为空时,才调用

supplier.get()方法产生对象。 - orElseThrow。当容器为空时,才调用

supplier.get()方法抛出异常。

@Test

public void optionGet() {

Optional<String> s = Optional.of("1");

log.info("创建一个有值的 Optional ==> {}", s);

Optional<Object> o = Optional.ofNullable(null);

log.info("创建一个为null的 Optional ==> {}", o);

try {

log.info("get => {}", s.get());

log.info("get => {}", o.get());

} catch (Exception ex) {

log.error("null get =>{}", ex.getMessage());

}

log.info("orElse => {}", s.orElse(pp("2")));

log.info("orElseGet => {}", s.orElseGet(() -> {

log.info(" 我被执行了 s1");

return "s1";

}));

log.info("orElse => {}", o.orElse(2));

log.info("orElseGet => {}", o.orElseGet(() -> {

log.info("s2");

return "s2";

}));

o.orElseThrow(() ->{

return new RuntimeException("空的异常");

});

}

private String pp(String str) {

log.info("我被执行了");

return str;

}

输出结果

17:03:21.566 [main] INFO top.zsmile.test.basic.stream.StreamTest - 创建一个有值的 Optional ==> Optional[1]

17:03:21.577 [main] INFO top.zsmile.test.basic.stream.StreamTest - 创建一个为null的 Optional ==> Optional.empty

17:03:21.578 [main] INFO top.zsmile.test.basic.stream.StreamTest - get => 1

17:03:21.578 [main] ERROR top.zsmile.test.basic.stream.StreamTest - null get =>No value present

17:03:21.578 [main] INFO top.zsmile.test.basic.stream.StreamTest - 我被执行了

17:03:21.578 [main] INFO top.zsmile.test.basic.stream.StreamTest - orElse => 1

17:03:21.633 [main] INFO top.zsmile.test.basic.stream.StreamTest - orElseGet => 1

17:03:21.633 [main] INFO top.zsmile.test.basic.stream.StreamTest - orElse => 2

17:03:21.633 [main] INFO top.zsmile.test.basic.stream.StreamTest - s2

17:03:21.633 [main] INFO top.zsmile.test.basic.stream.StreamTest - orElseGet => s2

java.lang.RuntimeException: 空的异常

// ....

可以从结果中看到,Optional 不为空时,orElse 依然调用方法并产生了一个String对象,orElseGet 没有调用方法。

所以可见orElseGet 更优, 但代价就是需要传入一个Supplier<T>类型的参数。

过滤

Optional<T> filter(Predicate<? super T> predicate) 如果容器不为空,则返回原先的值,如果predicate 返回 true,则返回原先的值,否则返回 empty

Optional<String> s = Optional.of("2");

log.info("原数据 {}", s);

Optional<String> s1 = s.filter(item -> {

if (item.equalsIgnoreCase("1")) {

return true;

} else {

return false;

}

});

log.info("filter {}", s1);

输出结果

17:45:34.594 [main] INFO top.zsmile.test.basic.stream.StreamTest - 原数据 Optional[2]

17:45:34.666 [main] INFO top.zsmile.test.basic.stream.StreamTest - filter Optional.empty

映射

- map:如果

Optional不为空,则将原先的值映射为新的对象,并用一个新的Optional存放。 - flatMap:如果

Optional不为空,则将原先的值映射为新的Optional对象。 - 二者区别在于:

map允许返回空值,而flat不允许为空。map的Function接口方法都是返回 Object,而flatMap返回的是Optional对象。

查找 find

- findFirst:获取第一个匹配的元素

- findAny:获取任意一个,经实验,多数为第一个

@Test

public void find() {

List<Double> collect = Stream.generate(Math::random).limit(999999).distinct().collect(Collectors.toList());

Optional<Double> first = collect.stream().findFirst();

log.info("findFirst => {}", first);

Optional<Double> any = collect.stream().findAny();

log.info("findAny => {}", any);

}

输出结果

11:15:02.155 [main] INFO top.zsmile.test.basic.stream.StreamTest - findFirst => Optional[0.7103524491747812]

11:15:02.161 [main] INFO top.zsmile.test.basic.stream.StreamTest - findAny => Optional[0.7103524491747812]

归并 reduce

reduce 有三个重要概念:

- Identity(初始值定义):归并操作的初始值,如果

Stream为空,也是默认返回值。 - accumulator(累进器):定义两个参数,第一个是上一次归并操作的返回值,第二个是

Stream的下一个元素。 - combiner(组合器):调用一个函数来组合归并操作的结果,当归并是用来并行执行或当累进器及实现类型不匹配时,才调用。

reduce 有三个重载方法。

- Optional

reduce(BinaryOperator accumulator); - 接收一个

BinaryOperator的 lambda表达式,返回一个Optional - 当执行结果为空时,返回的是

Optional.empty

- 接收一个

- T reduce(T identity, BinaryOperator

accumulator); - 与上一个不同的,它定义了一个初始值,并且返回值是与初始值类型相同

- 当执行结果为空时,返回的是默认值

- U reduce(U identity,BiFunction<U, ? super T, U> accumulator,BinaryOperator combiner);

- 主要是为了解决并发和复杂类型的计算,如例子所言,我想统计所有人的年龄总和,可是光用前两种参数,并没有办法执行统计后的数据类型。

@Test

public void reduce() {

List<Integer> collect = Stream.iterate(0, integer -> integer + 1).limit(10).collect(Collectors.toList());

log.info("原数据");

collect.stream().forEach(System.out::println);

log.info("总计:{}", collect.stream().reduce((a, b) -> a + b));

log.info("总计:{}", collect.stream().skip(10).reduce((a, b) -> a + b));

log.info("总计:{}", collect.stream().skip(10).reduce(0, (a, b) -> a + b));

log.info("原数据2");

userList.stream().forEach(System.out::println);

// 注意:这个写法无法通过编译,Stream的实现类型是 User,而累进器返回的类型是Integer,所以这需要另外使用Integer::sum 做组合操作。

// userList.stream().reduce(0, (a, b) -> a + b.getAge())

log.info("总计年龄:{}", userList.stream().reduce(0, (a, b) -> a + b.getAge(), Integer::sum));

}

输出结果

11:42:38.197 [main] INFO top.zsmile.test.basic.stream.StreamTest - 原数据

0

1

2

3

4

5

6

7

8

9

11:42:38.202 [main] INFO top.zsmile.test.basic.stream.StreamTest - 总计:Optional[45]

11:42:38.205 [main] INFO top.zsmile.test.basic.stream.StreamTest - 总计:Optional.empty

11:42:38.206 [main] INFO top.zsmile.test.basic.stream.StreamTest - 总计:0

11:42:38.206 [main] INFO top.zsmile.test.basic.stream.StreamTest - 原数据2

User(name=张三, age=18, roles=[ADMIN, USER])

User(name=李四, age=19, roles=[TEMP:USER])

User(name=王五, age=20, roles=[USER])

11:42:38.207 [main] INFO top.zsmile.test.basic.stream.StreamTest - 总计年龄:57

总结

合理正确的使用 Stream 流,可以给我们带来:

- 代码简洁。更贴合数据流处理的思想。

- 逻辑解耦。可以将各个任务分成多段流式进行处理。

- 延迟执行。只有调用终端方法时,前面编写的中间操作才会执行,避免不必要的操作损耗。

当然也会有些新的问题

- 调试不方便

- 需要适应语法,熟悉lambda的使用,才能更高效开发。

概述

- 面向对象编程思想

- 一切事物都是对象。

- 对象是其属性和操作的封装体。

- 强调的是对象,必须通过对象的形式来做事,一般情况下会比较复杂。

- 函数编程思想

- 函数强调的是按照输入量、输出量,使用输入量计算得出输出量。【拿什么东西做什么事情】

- 同样执行线程任务,使用函数编程思想,可以直接通过传递一段代码给线程对象执行,不需要创建任务对象。

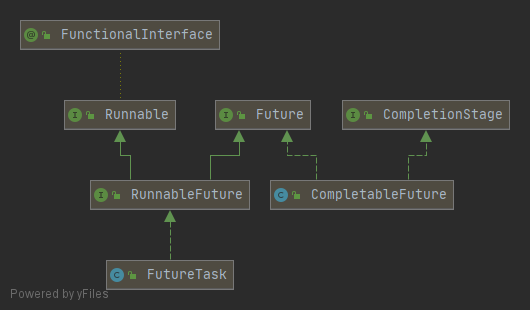

函数式接口

Functional interface 接口也称 SAM 接口,即Single Abstract Method interfaces,有且只有一个抽象方法的接口,但可以有多个非抽象方法的接口。

-

在 Java 8 中专门有一个包放函数式接口

java.util.function,该包下的所有接口都有@FunctionalInterface注解,提供函数式接口。 -

在其他包中也有函数式接口,其中一些没有

@FunctionalInterface注解,但是只要符合函数式接口的定义就是函数式接口,与是否有@FunctionalInterface注解无关,注解只是在编译时起到强制规范定义的作用。其在 Lambda 表达式中有广泛的应用。例如Runnable接口,也是没有使用@FunctionalInterface注解

什么是lambda

lambda 表达式,也可以称之为闭包或者匿名函数,是 Java8 引入的新特性。

lambda 允许把函数作为一个方法的参数(函数作为参数传入方法中执行)

lambda 使用前提

-

必须有相应的函数式接口。函数接口是指有且只有一个抽象方法的接口。

-

类型推断机制。在上下文信息足够的情况下,编译器可以推断出参数表的类型,而不需要显示指定。也就是方法的参数和局部变量的类型必须为

lambda对应的接口类型,才能使用lambda表达式表示该接口的实例。

语法

简写

(parameters) -> expression

(parameters) ->{ statements; }

重要特征:

- **可选类型声明:**不需要声明参数类型,编译器可以统一识别参数值。

- **可选的参数圆括号:**一个参数无需定义圆括号,但多个参数需要定义圆括号。

- **可选的大括号:**如果主体包含了一个语句,就不需要使用大括号。

- **可选的返回关键字:**如果主体只有一个表达式返回值则编译器会自动返回值,大括号需要指定表达式返回了一个数值。

方法引用

如果我们使用lambda 表达式的时候,如果要执行的表达式只是调用一个类已有的方法,那么就可以用方法引用的方式来替代。

重要特种:

- **引用静态方法:**类名::静态方法名。如果静态方法需要传参数,只要确保参数是一一对应的,编译器会自行推断出来。

- 引用对象方法:对象引用::方法名。如果执行的类是调用

lambda表达式所在的类的方法时,可以才作用一下写法this::方法名。 - 引用构造方法:类名::new。

实战

替代匿名内部类

class LambdaTest {

public static void main(String[] args) {

// 匿名内部类, Runnable

Thread thread = new Thread(new Runnable() {

@Override

public void run() {

System.out.println("线程输出");

}

});

// lambda

Thread thread1 = new Thread(() -> {

System.out.println("lambda线程输出");

});

}

}

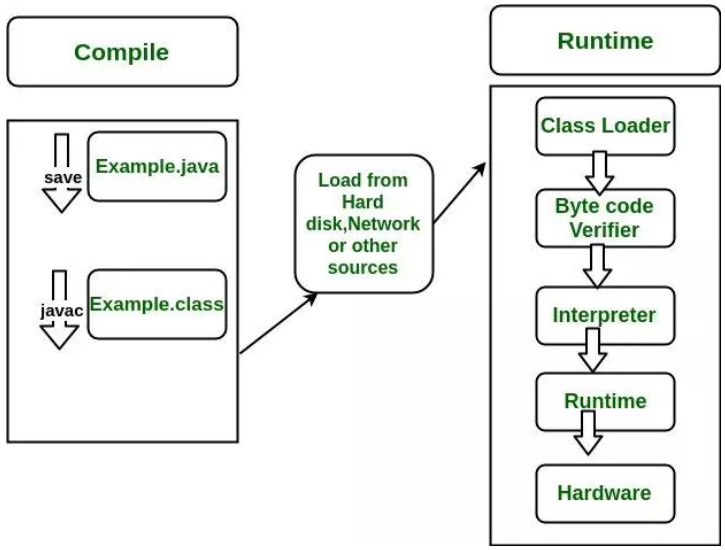

原理分析

那么用 lambda 来替代匿名内部类有什么差别呢?我们通过编译一下来看看

# 编译class文件

javac -encoding UTF-8 LambdaTest.java

可以看见产生了两个class文件。

-

LambdaTest.class

import top.zsmile.test.basic.lambda.LambdaTest.1; public class LambdaTest { public LambdaTest() { } public static void main(String[] var0) { new Thread(new 1()); new Thread(() -> { System.out.println("lambda线程输出"); }); } } -

LambdaTest$1.class。这是一个匿名内部类。

final class LambdaTest$1 implements Runnable { LambdaTest$1() { } public void run() { System.out.println("线程输出"); } }

那么我们来看看这个代码字节码,看看程序内部是怎么运行的。

javap -c “.\LambdaTest.class”

javap -c “.\LambdaTest$1.class”

这里我们只看主文件的字节码。

Compiled from "LambdaTest.java"

public class top.zsmile.test.basic.lambda.LambdaTest {

public top.zsmile.test.basic.lambda.LambdaTest();

Code:

0: aload_0

1: invokespecial #1 // Method java/lang/Object."<init>":()V

4: return

public static void main(java.lang.String[]);

Code:

0: new #2 // class java/lang/Thread

3: dup

4: new #3 // class top/zsmile/test/basic/lambda/LambdaTest$1

7: dup

8: invokespecial #4 // Method top/zsmile/test/basic/lambda/LambdaTest$1."<init>":()V

11: invokespecial #5 // Method java/lang/Thread."<init>":(Ljava/lang/Runnable;)V

14: astore_1

15: new #2 // class java/lang/Thread

18: dup

19: invokedynamic #6, 0 // InvokeDynamic #0:run:()Ljava/lang/Runnable;

24: invokespecial #5 // Method java/lang/Thread."<init>":(Ljava/lang/Runnable;)V

27: astore_2

28: return

}

由这个字节码信息可以分析出:

-

根据

4: new #3这行可以看出,这里使用了LambdaTest$1.class类,new了一个新的对象。 -

根据

19: invokedynamic #6, 0可以看出,lambda是通过invodedynamic实现的,并且不会生成新的类和对象。invodedynamic是Jvm提供的一种指令语法。在这里作用是创建并调用Runnable接口 run 方法。而新增的

invokedynamic指令,配合新增的方法句柄(Method Handles,它可以用来描述一个跟类型A无关 的方法m的签名,甚至不包括方法名称,这样就可以做到我们使用方法m的签名,但是直接执行的时候调用 的是相同签名的另一个方法b),可以在运行时再决定由哪个类来接收被调用的方法。在此之前,只能使用反射来实现类似的功能。该指令使得可以出现基于Jvm的动态语言,让Jvm更加强大。而且在Jvm上实现动态调用机制,不会破坏原有的调用机制。这样既很好的支持了Scala、Clojure这些JVM上的动态语言,又可以支持代码里的动态lambda表达式。简单来说就是以前设计某些功能的时候把做法写死在了字节码里,后来想改也改不了了。 所以这次给lambda语法设计翻译到字节码的策略是就用invokedynamic来作个弊,把实际的翻译策略隐 藏在Jdk 库的实现里(MetaFactory)可以随时改,而在外部的标准上大家只看到一个固定的 invokedynamic。

-

既然

lambda不会生成新的类,那么这里的this指向外部类的。简单上个demo。可以看出使用匿名内部类时,this指向当前类,而lambda没有生成新的类,所以指向的外部类,所以无法在静态static方法中使用,因为static方法没有实例对象。public class LambdaTest { public void run(){ new Thread(new Runnable() { @Override public void run() System.out.println(this); System.out.println("线程输出"); } }).start(); // lambda new Thread(() -> { System.out.println(this); System.out.println("lambda线程输出"); }).start(); } public static void main(String[] args) { new LambdaTest().run(); } } // 输出结果 // top.zsmile.test.basic.lambda.LambdaTest$1@1232cc0 // 线程输出 // top.zsmile.test.basic.lambda.LambdaTest@7e8572a1 // lambda线程输出

为什么不能修改外部变量

lambda 表达式的局部变量可以不用声明为 final ,但是必须不可被 lambda 内部的代码修改(即具有隐性的 final )。可是我们有时又能修改局部变量的值,这是为什么呢?

其实这和变量的类型和 final 的作用有关联,如果我们使用一些常用的类型。例如:

- 基础类型:int,float等

- 简单引用类型:String,Integer等

- 复杂对象引用

- 静态类型引用

上个简单的例子说明一下;

public class LambdaTest {

public void run() {

String fff = "";

new Thread(() -> {

this.name = "456";

// fff="456";

//Variable used in lambda expression should be final or effectively final

System.out.println(this.name);

System.out.println("lambda线程输出");

}).start();

}

}

这里提到了 final or effectively final。

对于一个变量,如果没有给它加final修饰,而且没有对它的二次赋值,那么这个变量就是effectively final(有效的不会变的),如果加了final那肯定是不会变了哈。

那么如果我们想要在内部更改外部的属性,有什么方式?

- 使用对象的属性

- 使用引用的属性

- 使用静态的属性

总结

lambda 的优点:

- 简化了部分的写法,使代码更为简洁紧凑

- 减少匿名内部类的创建,节省内存开支

- 不需要记忆所使用的接口和抽象函数

lambda 的缺点:

- 易读性较差,阅读代码的人需要熟悉

lambda表达式和抽象函数中参与的类型。 - 不具备匿名内部类可扩展的特性

引用

- https://www.oracle.com/java/technologies/java8.html

- https://mp.weixin.qq.com/s?__biz=MjM5MDE0Mjc4MA==&mid=2651144680&idx=5&sn=cea5cf2b8748e4e94894558914bf26ec&chksm=bdb8b9bb8acf30ad90011a970dd18acbe2be555609d348601d76d566e4be7e4aad2b6c719e7a&scene=27#wechat_redirect

- https://www.infoq.cn/article/LlrBgvdmYPGNsVDOZuCZ

- https://xie.infoq.cn/article/a7a4b91228653c64f866367ca

- https://mp.weixin.qq.com/s?__biz=MzAxODcyNjEzNQ==&mid=2247550085&idx=5&sn=d13402dde3e283ce0140515d6347873f&chksm=9bd3a91daca4200bae75e718a36fc5aaa85f19d03f6436f1c64f86b6d1848051c4a9f6414754&scene=27#wechat_redirect

- https://xie.infoq.cn/article/b47fa71dff45feb333a31c6dc

- https://blog.csdn.net/qq_31635851/article/details/116484594

消除if-else

消除单个IF-else

- 定义函数式接口

创建一个名为IfElseFunction的函数式接口,接口的参数为两个Runnable接口。这两个两个Runnable接口分别代表了为true或false时要进行的操作。

- 编写判断方法

在里面设置了一个静态方法 isTrueOrFalse,接收 boolean 类型传参,并返回 IfElseFunction 函数接口。

@FunctionalInterface

public interface IfElseFunction {

void trueOrFalseHandle(Runnable trueRun, Runnable falseRun);

static IfElseFunction isTrueOrFalse(boolean bool) {

return (tr, fr) -> {

if (bool) {

tr.run();

} else {

fr.run();

}

};

}

}

- 使用方式

@Test

public void test4() {

// 判断是否

IfElseFunction.isTrueOrFalse(true).trueOrFalseHandle(() -> {

System.out.println("我是对的");

}, () -> {

System.out.println("我是错的");

});

// 可以稍微转换一下,用来判断空值并做操作

String name = null;

IfElseFunction.isTrueOrFalse(name != null).trueOrFalseHandle(() -> {

System.out.println("我的名字是:" + name);

}, () -> {

System.out.println("我不知道我的名字");

});

}

消除多个if-else

还是用静态方法 IfElseFunction 接口,我们稍微改写一下使用方式即可。这里面可以看出使用了策略模式。

private static Map<String, Runnable> map;

@Before

public void before() {

map = new HashMap<>();

map.put("A", () -> {

System.out.println("I’m A");

});

map.put("B", () -> {

System.out.println("I’m B");

});

map.put("C", () -> {

System.out.println("I’m C");

});

map.put("D", () -> {

System.out.println("I’m D");

});

}

@Test

public void test5() {

String searchKey = "F";

IfElseFunction.isTrueOrFalse(map.get(searchKey) != null).trueOrFalseHandle(map.get(searchKey), () -> {

System.out.println("找不到用户");

});

}

前言

在 lambda 中了解了什么是函数式接口,以及 @FunctionalInterface 注解。

我们知道函数式接口中,有且只有一个抽象方法的接口,但可以有多个非抽象方法的接口。

而 @FunctionalInterface 注解是可以检查一个接口是否为函数式接口。只是在编译时强制规范使用。 如果接口是函数接口,编译通过;如果不是,编译失败。

我们自定义函数式接口时,@FuncationalInterface 注解是可选的,就算我们不写这个注解,只要保证是函数式接口也是可以的。但是建议加上。

Java 8 在 java.util.function 包下预定了大量的函数式接口供我们使用。常用的有:

- 生产型 Supplier 接口

- Function 接口

- Consumer 接口

- Predicate 接口

生产型 Supplier

java.util.function.Supplier<T> 接口仅包含一个无参的方法 T get()。用来获取一个泛型参指定类型的对象数据。

@FunctionalInterface

public interface Supplier<T> {

/**

* Gets a result.

*

* @return a result

*/

T get();

}

案例

@Test

public void test() {

String string = supplierGet(() -> {

return "supplier test";

});

System.out.println(string);

}

private static <T> T supplierGet(Supplier<T> sup) {

return sup.get();

}

消费型 Consumer

java.util.function.Consumer<T> 接口与 Supplier 接口相反,它是消费一个数据,不产生输出,其类型是一个泛型。Consumer 中包含抽象方法void accept(T t) 意思接受一个指定泛型的数据进行处理,此外还有一个默认实现方法 Consumer<T> andThen(Consumer<? super T> after)。

@FunctionalInterface

public interface Consumer<T> {

/**

* Performs this operation on the given argument.

*

* @param t the input argument

*/

void accept(T t);

default Consumer<T> andThen(Consumer<? super T> after) {

Objects.requireNonNull(after);

return (T t) -> { accept(t); after.accept(t); };

}

}

案例_accept

@Test

public void test() {

consumerAccept("qweqweqwe", (item) -> {

String s = new StringBuilder(item.toString()).reverse().toString();

System.out.println(s);

});

}

private static <T> void consumerAccept(T name, Consumer<T> com) {

com.accept(name);

}

}

这里无论 Consumer 都会将其做一次反转后,进行打印。

案例_andThen

@Test

public void test2() {

consumerAndThen("qwE123", (item) -> {

System.out.println("先执行了我");

String s = new StringBuilder(item.toString()).reverse().toString();

System.out.println(s);

}, item -> {

System.out.println("后执行了我");

String s = item.toUpperCase().toLowerCase();

System.out.println(s);

});

}

private static <T> void consumerAndThen(T name, Consumer<T> com, Consumer<T> com2) {

com.andThen(com2).accept(name);

}

输出结果

先执行了我

321Ewq

后执行了我

qwe123

这里需要注意的点是:

- 都是对原数据进行了操作,如果是基本类型值不变,如果是引用对象,只修改了引用对象的内部值。

- 在

consumer内部修改方法剧本变量的值,会提示异常Variable used in lambda expression should be final or effectively final。这是一个隐式的final。 - 这里可以做链式消费数据,但是需要主要处理对象的主体。

判断型 Predicate

java.util.function.Predicate<T> 接口是接受一个特定泛型的数据,从而获得一个 boolean 结果。其中包含一个抽象方法 boolean test(T t), 根据传入参数做检查后,返回true/false。2

@FunctionalInterface

public interface Predicate<T> {

boolean test(T t);

default Predicate<T> and(Predicate<? super T> other) {

Objects.requireNonNull(other);

return (t) -> test(t) && other.test(t);

}

default Predicate<T> negate() {

return (t) -> !test(t);

}

default Predicate<T> or(Predicate<? super T> other) {

Objects.requireNonNull(other);

return (t) -> test(t) || other.test(t);

}

static <T> Predicate<T> isEqual(Object targetRef) {

return (null == targetRef)

? Objects::isNull

: object -> targetRef.equals(object);

}

}

案例_test

@Test

public void test() {

boolean checkBool = predicateTest("str", item -> {

if (item instanceof String) {

return true;

}

return false;

});

System.out.println(checkBool);

}

private static <T> boolean predicateTest(T obj, Predicate<T> predicate) {

return predicate.test(obj);

}

案例_negate

Predicate 提供了一个 negate,意为取反,即将返回boolean进行非处理。

@Test

public void tes2() {

boolean checkBool = predicateNegate("str", item -> {

if (item instanceof String) {

return true;

}

return false;

});

System.out.println(checkBool);

}

private static <T> boolean predicateNegate(T obj, Predicate<T> predicate) {

// 等效于 !predicate.test(obj);

return predicate.negate().test(obj);

}

案例_and

Predicate 接口中有一个方法 and,表示并且关系,同时满足返回 TRUE。

/**

* 1. 判断是否为String类型

* 2. 判断是否以STR开始

* 两个调价你必须同时满足

*/

@Test

public void tes3() {

boolean checkBool = predicateAnd(Integer.valueOf(123), item -> {

System.out.println("type");

if (String.class.isInstance(item) ) {

return true;

}

return false;

}, item -> {

System.out.println("starts");

if (item.toString().toUpperCase().startsWith("STR")) {

return true;

}

return false;

});

System.out.println(checkBool);

}

private static <T> boolean predicateAnd(T obj, Predicate<T> predicate, Predicate<T> predicate2) {

// 等效于 predicate.test(obj) && predicate2.test(obj);

return predicate.and(predicate2).test(obj);

}

案例_or

Predicate 接口中有一个方法 or,表示或关系,满足一个返回 TRUE。

/**

* 1. 判断是否为Integer类型

* 2. 判断是否以STR开始

* 两个条件满足一个

*/

@Test

public void test4() {

boolean checkBool = predicateOr(String.valueOf("STR111"), item -> {

System.out.println("type");

if (Integer.class.isInstance(item)) {

return true;

}

return false;

}, item -> {

System.out.println("starts");

if (item.toString().toUpperCase().startsWith("STR")) {

return true;

}

return false;

});

System.out.println(checkBool);

}

private static <T> boolean predicateOr(T obj, Predicate<T> predicate, Predicate<T> predicate2) {

// 等效于 predicate.test(obj) || predicate2.test(obj);

return predicate.or(predicate2).test(obj);

}

类型转换 Function

ava.util.function.Function<T,R> 用来根据一个类型的数据得到另一个类型的数据,前者 T 称为前置条件/传入参数,后者 R 成为后置条件/返回参数。提供了一个最主要的抽象方法 R apply(T t),根据 T 类型的数据获取 R 类型的结果。使用场景:类型转换。

@FunctionalInterface

public interface Function<T, R> {

R apply(T t);

default <V> Function<V, R> compose(Function<? super V, ? extends T> before) {

Objects.requireNonNull(before);

return (V v) -> apply(before.apply(v));

}

default <V> Function<T, V> andThen(Function<? super R, ? extends V> after) {

Objects.requireNonNull(after);

return (T t) -> after.apply(apply(t));

}

static <T> Function<T, T> identity() {

return t -> t;

}

}

案例_apply

@Test

public void test() {

Integer integer = functionTest("123123", item -> {

return Integer.valueOf(item);

});

System.out.println(integer);

}

public static <T, R> R functionTest(T obj, Function<T, R> function) {

return function.apply(obj);

}

案例_compose

接口中的默认方法 compose 用来进行组合操作。传入一个 function 先执行,并将处理结果传入下一个 function

/**

* 1. 执行apply(4),将“4” 传入到fc2 转换为 Integer输出

* 2. 在执行fc1 的apply方法,将Integer 4传入。

*/

@Test

public void test2() {

Function<Integer, Integer> fc1 = i -> i * 2;

Function<String, Integer> fc2 = i -> Integer.valueOf(i);

System.out.println(fc1.compose(fc2).apply("4"));

}

案例_andThen

默认方法 andThen 用来进行组合操作。传入一个 function 后执行,并将处理结果传入下一个 function。与compose 功能相反,andThen 添加到后面执行,compose 插入到前面执行

/**

* 1. 接收到 int 4 后,乘以2后,得出8返回

* 2. 将 int 8 传入,转换为 String 返回

*/

@Test

public void test3() {

Function<Integer, Integer> fc1 = i -> i * 2;

Function<Integer, String> fc2 = i -> i + "";

System.out.println(fc1.andThen(fc2).apply(4));

}

final

用法

- 被final修饰的类不可以被继承

- 被final修饰的方法不可以被重写

- 被final修饰的变量不可以被改变.如果修饰引用,那么表示引用不可变,引用指向的内容可变.

- 被final修饰的方法,JVM会尝试将其内联,以提高运行效率

- 被final修饰的常量,在编译阶段会存入常量池中

两个重排序规则:

- 在构造函数内对一个final域的写入,与随后把这个被构造对象的引用赋值给一个引用变量,这两个操作之间不能重排序

- 初次读一个包含final域的对象的引用,与随后初次读这个final域,这两个操作之间不能重排序。

注意

final和static修饰

用final和static修饰的属性变量(特别是在单例模式),static里面出现trycatch时,需要throw异常,否则会编译错误。

解释: 当属性被static和final同时修饰时,该属性属于类属性(类常量),就是说在类被加载进内存时就需要分配内存(初始化完成)。而构造函数是在被实例化的时候才会执行,对比static代码块是在类被加载的时候执行,且只执行这一次

一道面试题分析

最近看面试题的时候,看到这样一道题目。觉得有意思,就分析了一下看看。

public class FinalStaticClass {

public static void main(String[] args) {

System.out.println(Price.P.Price);//result:-2.7

}

}

class Price {

/**

* method1: give apple add final, result:17.3;

* method2: Swap 18 to 19, result:17.3;

*/

static Price P = new Price(2.7);

static double apple = 20;

double Price;

public Price(double orange) {

Price = apple - orange;

}

}

我们先看一下执行结果。输出2.7

为什么不是17.3呢?让我们先执行一下以下两个指令,生成反汇编文件:

javac .\FinalStaticClass

javap -c -verbose .\FinalStaticClass.class > FinalStaticClass.txt

javap -c -verbose .\Price.class >Price.txt

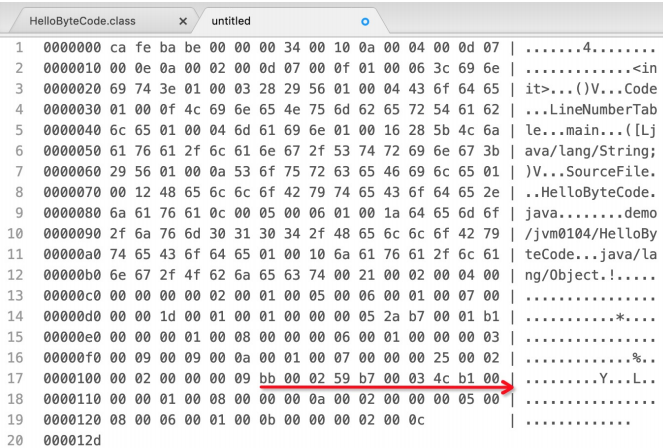

分析

让我们查看一下Price.txt

// from 75 to 82

0: new #4 // class top/zsmile/jvm/base/Price

3: dup

4: ldc2_w #5 // double 2.7d

7: invokespecial #7 // Method "<init>":(D)V

10: putstatic #8 // Field P:Ltop/zsmile/jvm/base/Price;

13: ldc2_w #9 // double 20.0d

16: putstatic #2 // Field apple:D

19: return

// Constant Pool

#1 = Methodref #11.#25 // java/lang/Object."<init>":()V

#2 = Fieldref #4.#26 // top/zsmile/jvm/base/Price.apple:D

#3 = Fieldref #4.#27 // top/zsmile/jvm/base/Price.Price:D

#4 = Class #28 // top/zsmile/jvm/base/Price

#5 = Double 2.7d

#7 = Methodref #4.#29 // top/zsmile/jvm/base/Price."<init>":(D)V

#8 = Fieldref #4.#30 // top/zsmile/jvm/base/Price.P:Ltop/zsmile/jvm/base/Price;

#9 = Double 20.0d

这里可以看出执行过程是:

- new Price

- 将double 2.7d 入栈

- 执行类初始化,构造方法

- 将double 2.7d 出栈,存入 Price.P

- 将double 20.0d 入栈

- 将double 20.0d 出栈,存入 Price.apple

我们可以看出,在执行构造方法计算 Price(D)的时候,apple还没有赋值20。我们知道对于数字基本类型的时候,默认值都为0。于是在执行构造函数的时候,相当于:0-2.7,所以得出结果-2.7。

这是因为在随后的类加载的初始化阶段,由于static代码块执行顺序是由字段在源文件中出现的顺序决定的,所以会先执行new Price(2.7),分配对象空间并对其做初始化,此时apple的值为0,所以最终结果是-2.7。

那么我们有什么方法解决这个问题?(暂时想到2种)

- 交换P和apple

- 给apple 添加关键字final。

方法1(交换p和apple)

交换后,Price代码如下:

class Price {

static double apple = 20;

static Price P = new Price(2.7);

double Price;

public Price(double orange) {

Price = apple - orange;

}

}

// result : 17.3

老规矩生成汇编代码:

javac .\FinalStaticClass

javap -c -verbose .\Price.class >Price2.txt

让我们查看一下Price.txt

// from 75 to 82

0: ldc2_w #4 // double 20.0d

3: putstatic #2 // Field apple:D

6: new #6 // class top/zsmile/jvm/base/Price

9: dup

10: ldc2_w #7 // double 2.7d

13: invokespecial #9 // Method "<init>":(D)V

16: putstatic #10 // Field P:Ltop/zsmile/jvm/base/Price;

19: return

这里我们可以看到:

- 将20赋值给apple

- new Price。dup是交换栈的操作,可以看做将栈顶空出。

- 将2.7赋值给P。

- 执行构造函数,

方法2(给apple加上final关键字)

添加后,代码如下:

class Price {

/**

* method1: give apple add final keyword, result:17.3;

* method2: Swap 18 to 19, result:17.3;sfsdfsdf

*/

static Price P = new Price(2.7);

final static double apple = 20;

double Price;

public Price(double orange) {

Price = apple - orange;

}

}

javac .\FinalStaticClass

javap -c -verbose .\Price.class >Price3.txt

还是看Price文件。不过这次看两个地方

// from 43 to 46

static final double apple;

descriptor: D

flags: ACC_STATIC, ACC_FINAL

ConstantValue: double 20.0d

// from 74 to 80

0: new #2 // class top/zsmile/jvm/base/Price

3: dup

4: ldc2_w #6 // double 2.7d

7: invokespecial #8 // Method "<init>":(D)V

10: putstatic #9 // Field P:Ltop/zsmile/jvm/base/Price;

13: return

上面代码我们可以得出:apple已经有初始值了,值为20;static代码中只有存入p和执行构造函数。 也就是说现在构造函数的执行,是 20-2.7=17.3。

因为在类加载过程中,会将类中的字面量存入常量池中。而在遇到final关键字时,在编译时,会为该静态属性赋予ConstantValue属性,ConstantValue的作用是使JVM自动为静态变量赋值。

类变量,有两种方式赋值:

- 类构造器方法

- ConstantValue。将会在类加载的准备阶段被赋予所指定的值(这是final static字段必须赋值的原因)

老规矩写的不清晰的地方,可以指出,我会不定时更新和修改。一起加油.

所有的伟大,都来自于一个勇敢的开始。

前言

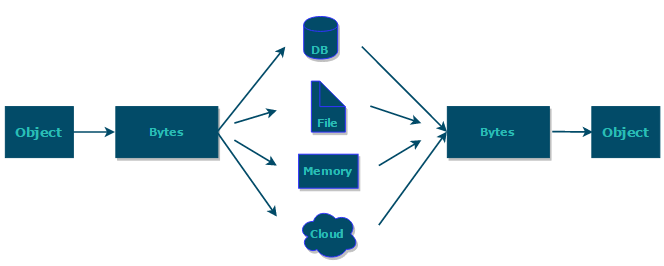

正常情况下,Java 对象都是保存在 Jvm 的堆内存中的,也就是 Jvm 不在了后,对象也会跟着销毁了。

而序列化相当于提供了一种解决方案,让我们可以在 Jvm 停止前,将对象持久化到磁盘上。这样当再次需要这个对象的时候,我们可以从磁盘中读取出来,反序列化为对象使用。

但是序列化和反序列化,不仅要求类实现了 Serializable 或 Externalizable 序列化接口,还取决于类路径以及类属性是否一致,此外还有一个非常重要的一点就是 序列化ID 要求一致,这个序列化ID就是 SerialVersionUID

作用

在进⾏反序列化时, JVM会把传来的字节流中的

serialVersionUID与本地相应实体类的serialVersionUID进⾏⽐较, 如果相同就认为是⼀致的, 可以进⾏反序列化, 否则就会出现序列化版本不⼀致的异常, 即是InvalidCastException。

当实现java.io.Serializable接口的类没有显式地定义⼀个serialVersionUID变量时候, Java序列化机制会根据编译的Class⾃动⽣成⼀个 serialVersionUID 作序列化版本⽐较⽤, 这种情况下, 如果Class⽂件没有发⽣变化, 就算再编译多次, serialVersionUID 也不会变化的。 但是如果一个Class文件发生变化,那么serialVersionUID 就会发生变化。

也就是说,我们的类实现了 SerialVersion 接口,但是没有定义 SerialVersionUID ,然后序列化。在序列化后,由于某些原因,对类做了变更(比如增加了一个字段),那么重启应用后,对之前序列化的类做反序列化,就会抛出异常。

显式定义

如果我们没有在Class中明确定义一个SerialVersionUID 会有什么问题呢?

先上我们序列化和反序列化代码:

@Test

public void serializationTest() {

SerializationIdClazz serializationClazz = new SerializationIdClazz("SerializationIdClazz", 20);

try {

//序列化

ObjectOutputStream objectOutputStream = new ObjectOutputStream(new FileOutputStream("out.txt"));

objectOutputStream.writeObject(serializationClazz);

objectOutputStream.close();

} catch (IOException e) {

e.printStackTrace();

}

}

@Test

public void deserializationTest() {

try {

// 反序列化

ObjectInputStream objectInputStream = new ObjectInputStream(new FileInputStream("out.txt"));

SerializationIdClazz newClazz = (SerializationIdClazz) objectInputStream.readObject();

log.info("反序列化后对象:{}", newClazz);

objectInputStream.close();

} catch (IOException e) {

e.printStackTrace();

} catch (ClassNotFoundException exception) {

exception.printStackTrace();

}

}

然后是我们测试类。r

@Slf4j

@Data

class SerializationIdClazz implements Serializable {

/**

* 名称

*/

private String name;

/**

* 年龄

*/

private Integer age;

/**

* 构造器

*/

public SerializationIdClazz(String name) {

log.info("SerializationIdClazz Construct:name={}", name);

this.name = name;

}

public SerializationIdClazz(String name, Integer age) {

log.info("SerializationIdClazz Construct:name={},age={}", name, age);

this.name = name;

this.age = age;

}

}

不定义 SerialVersionUID ,我们直接进行序列化操作,然后对该类增加一个属性(性别sex)。

@Slf4j

@Data

class SerializationIdClazz implements Serializable {

/**

* 名称

*/

private String name;

/**

* 年龄

*/

private Integer age;

/**

* 性别

*/

private int sex;

/**

* 构造器

*/

public SerializationIdClazz(String name) {

log.info("SerializationIdClazz Construct:name={}", name);

this.name = name;

}

public SerializationIdClazz(String name, Integer age) {

log.info("SerializationIdClazz Construct:name={},age={}", name, age);

this.name = name;

this.age = age;

}

}

执行结果:

java.io.InvalidClassException: SerializationIdClazz; local class incompatible: stream classdesc serialVersionUID = 3361313294555402592, local class serialVersionUID = -4142228557208270752

抛出了 InvalidClassException 并且前后自动生成的 serialVersionUID 是不一样的。

所以,一旦类实现了Serializable,就建议明确的定义一个serialVersionUID。不然在修改类的时候,就会发生异常。

设置字段不参加序列化

对于不想进行序列化的变量,可以使用 transient 关键字修饰。

transient 关键字的作用是:阻止实例中那些用此关键字修饰的的变量序列化;当对象被反序列化时,被 transient 修饰的变量值不会被持久化和恢复。

关于 transient 还有几点注意:

- transient 只能修饰变量,不能修饰类和方法。

- transient 修饰的变量,在反序列化后变量值将会被置成类型的默认值。例如,如果是修饰 int 类型,那么反序列后结果就是 0。

- static 变量因为不属于任何对象(Object),所以无论有没有 transient 关键字修饰,均不会被序列化。

原理分析

我们看一下源码针对于读取时,serialVersionUID 不一致抛 InvalidClassException异常。

s=>start: 开始

e=>end: 结束

readObject=>operation: readObject

readObject0=>operation: readObject0

readOrdinaryObject=>operation: readOrdinaryObject

readClassDesc=>operation: readClassDesc

readNonProxyDesc=>operation: readNonProxyDesc

initNonProxy=>operation: initNonProxy

s->readObject->readObject0->readOrdinaryObject->readClassDesc->readNonProxyDesc->initNonProxy->e

我们直接看异常抛出的关键代码

/**

* Initializes class descriptor representing a non-proxy class.

*/

void initNonProxy(ObjectStreamClass model,

Class<?> cl,

ClassNotFoundException resolveEx,

ObjectStreamClass superDesc)

throws InvalidClassException

{

// 当前model的序列化ID,如果为空则重新计算。

long suid = Long.valueOf(model.getSerialVersionUID());

// 省略部分代码

if (model.serializable == osc.serializable &&

!cl.isArray() &&

suid != osc.getSerialVersionUID()) {

throw new InvalidClassException(osc.name,

"local class incompatible: " +

"stream classdesc serialVersionUID = " + suid +

", local class serialVersionUID = " +

osc.getSerialVersionUID());

}

}

比较两个serialVersionUID 是否一致。如果不相等则抛出异常。

SerialVersionUID不是被static变量修饰了吗

static 修饰的变量是静态变量,位于方法区,本身是不会被序列化的。 static 变量是属于类的而不是对象。你反序列之后,static 变量的值就像是默认赋予给了对象一样,看着就像是 static 变量被序列化,实际只是假象罢了。

生成serialVersionUID

生成serialVersionUID 的方式主要有2种:

-

使用默认的1L。

private static final Long serialVersionUID = 999L; -

根据类名、接口名、成员方法及属性等来生成一个64位的哈希字段 。可以借助IDE工具生成。

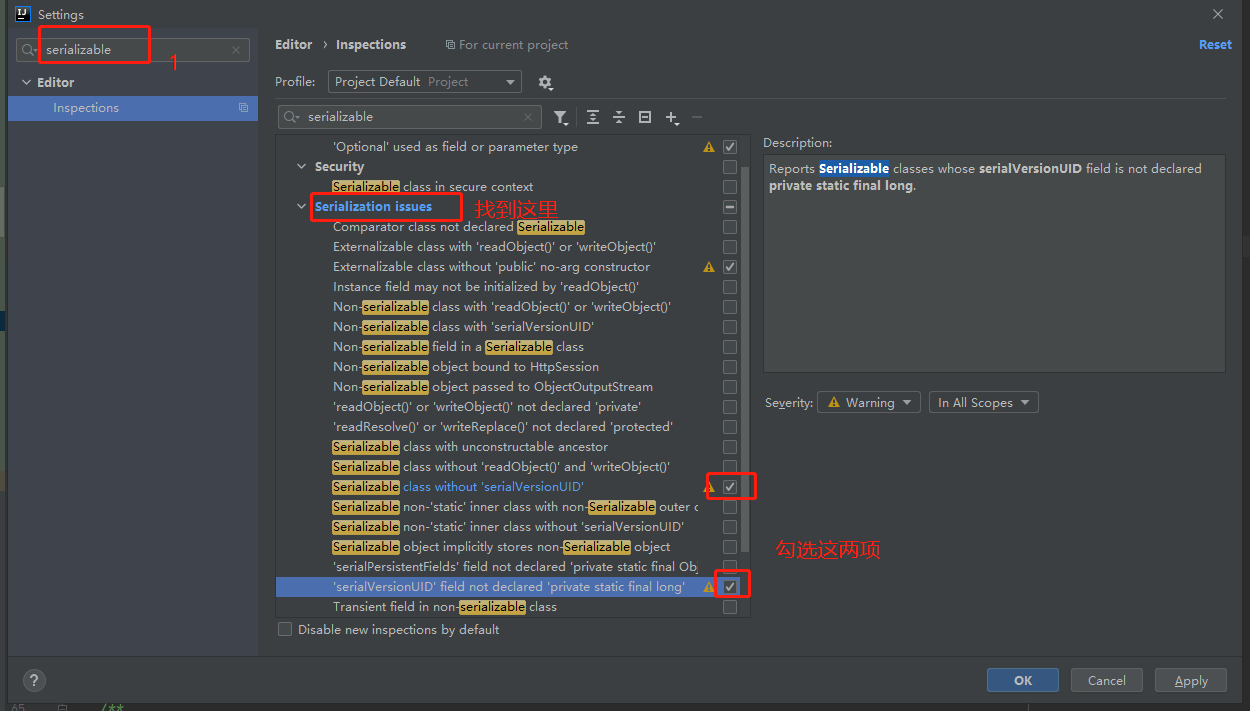

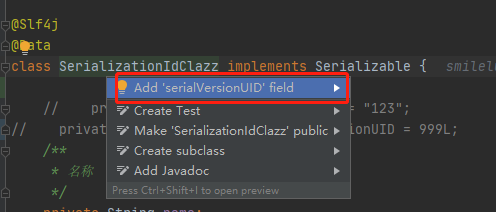

IDEA设置后,才能自动生成

- 进入 Settings 设置。

- 在实现了

Serializable的类使用快捷键Alt + Enter。

总结

- 当一个类实现

serializable接口时,最好定义serialVersionUID serialVersionUID主要是用来验证版本一致性的。所以兼容升级时,不要修改serialVersionUID。- 非兼容升级时,要修改

serialVersionUID。但是要做好异常处理。

反射对单例的破坏

测试的单例类:

@Data

class Singleton implements Serializable{

private volatile static Singleton instance;

private Singleton() {

}

public static Singleton getInstance() {

if (instance == null) {

synchronized (Singleton.class) {

if (instance == null) {

instance = new Singleton();

}

}

}

return instance;

}

}

测试方法:

@Test

public void test1() throws IllegalAccessException, InstantiationException, NoSuchMethodException, InvocationTargetException {

Singleton instance = Singleton.getInstance();

Constructor<Singleton> constructor = Singleton.class.getDeclaredConstructor();

constructor.setAccessible(true);

Singleton singleton = constructor.newInstance();

log.info("instance==singleton ==> {}", instance == singleton);

}

输出结果:

ReflexTest - instance==singleton ==> false

我们可以知道反射会破坏单例性,而且这种方式是无法避免的,那么序列化对单例的破坏呢?

序列化对单例的破坏

单例的测试类:

@Data

class Singleton implements Serializable{

private volatile static Singleton instance;

private Singleton() {

}

public static Singleton getInstance() {

if (instance == null) {

synchronized (Singleton.class) {

if (instance == null) {

instance = new Singleton();

}

}

}

return instance;

}

}

测试方法:

@Test

public void test2() throws Exception {

Singleton singleton = Singleton.getInstance();

try {

//序列化

ObjectOutputStream objectOutputStream = new ObjectOutputStream(new FileOutputStream("out.txt"));

objectOutputStream.writeObject(singleton);

objectOutputStream.close();

// 反序列化

ObjectInputStream objectInputStream = new ObjectInputStream(new FileInputStream("out.txt"));

Singleton newClazz = (Singleton) objectInputStream.readObject();

log.info("反序列化后对象:{}", newClazz);

objectInputStream.close();

log.info("newClazz==singleton ==> {}", newClazz == singleton);

} catch (IOException e) {

e.printStackTrace();

} catch (ClassNotFoundException exception) {

exception.printStackTrace();

}

}

输出结果:

ReflexTest - 反序列化后对象:Singleton()

ReflexTest - newClazz==singleton ==> false

通过对 Singleton 的序列化和反序列化,生成了一个新的对象,破坏了 Singleton 的单例性。那么我们可以通过深入理解一下反序列化过程中发生了什么?ObjectInputStream 如何起作用的?

ObjectInputStream

分析一下 ObjectInputputStream 的 readObject 方法执行情况到底是怎样的。

大致流程

st=>start: 开始

e=>end: 结束

readObject=>operation: readObject

readObject0=>operation: readObject0

switchType=>condition: 判断类别为对象 TC_OBJECT

readObject=>operation: readObject

op=>operation: 其它操作

readOrdinaryObject=>operation: readOrdinaryObject

st->readObject->readObject0->switchType

switchType(yes)->readOrdinaryObject->e

switchType(no)->op

核心代码分析

// readOrdinaryObject

private Object readOrdinaryObject(boolean unshared)

throws IOException

{

if (bin.readByte() != TC_OBJECT) {

throw new InternalError();

}

// 检查引用的类实例是否允许反序列化

ObjectStreamClass desc = readClassDesc(false);

desc.checkDeserialize();

// 加载类

Class<?> cl = desc.forClass();

if (cl == String.class || cl == Class.class

|| cl == ObjectStreamClass.class) {

throw new InvalidClassException("invalid class descriptor");

}

Object obj;

try {

// 类是否可以在运行时进行初始化,可以则调用初始化,这里就会破坏单例模式

obj = desc.isInstantiable() ? desc.newInstance() : null;

} catch (Exception ex) {

throw (IOException) new InvalidClassException(

desc.forClass().getName(),

"unable to create instance").initCause(ex);

}

passHandle = handles.assign(unshared ? unsharedMarker : obj);

ClassNotFoundException resolveEx = desc.getResolveException();